Serwerownie

Wentylacja oraz chłodzenie w pomieszczeniach UPS oraz w pomieszczeniach baterii

Żywotność komponentów UPS, jego wydajność i ciągła dostępność wprost zależą od utrzymania urządzenia w granicach temperatury i wilgotności oraz czystości na zapylenie określonej przez jego producenta (dalej: warunki środowiska).

Celem tego artykułu jest opisanie zasad projektowania systemów wentylacji i klimatyzacji pomieszczenia UPS z uwzględnieniem baterii kwasowo-ołowiowych (VRLA) lub akumulatorów litowo-jonowych (LiB).

Warunki środowiska pracy mogą być specyficzne dla każdego UPS i zależą od jego Producenta.

Prąd płynąc przez obwody elektryczne zasilacza UPS podczas jego działania wytwarza ciepło, które będzie się kumulować i wpływać na warunki środowiska, jeśli nie zostanie prawidłowo usunięte.

W zależności od wytycznych danego producenta (poza urządzeniami przeznaczonymi do pracy w trudnych warunkach przemysłowych), temperatury środowiska nie powinny być wyższe niż 30-40°C bez określonej wilgotności względnej (maksymalnie do 95% bez kondensacji).

Przekroczenie tych zaleconych temperatur lub praca w wyższych temperaturach przez dłuższy czas wpływa na trwałość UPS-ów oraz zwiększa ryzyko wystąpienia nieprzewidzianych incydentów związanych z awariami.

Dla prawidłowego określenia aktualnego strumienia ciepła do chłodzenia tylko od UPS-a należy wziąć pod uwagę następujące dane wejściowe:

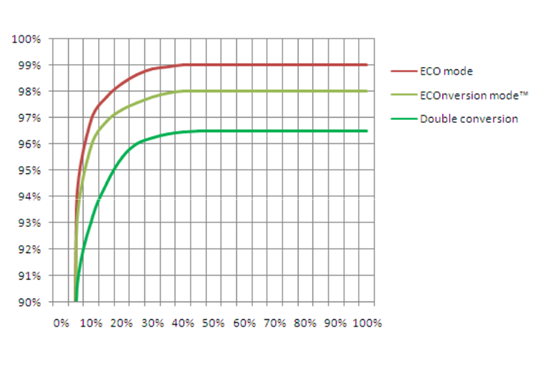

- tryb pracy zasilacza UPS / sprawność urządzenia z uwagi na sprawność przetwarzania postaci energii (sprawność urządzenia = energia na wyjściu / energia na wejściu)

- tryb pracy ECO – tryb pracy UPS z zasilaniem odbiorników poprzez by-pass (bez zamiany postaci energii AC/DC - prostownik - > DC/AC - falownik) – w tym trybie pracy producenci podają najczęściej najwyższą sprawność urządzenia (około 99% max.) / najniższa dostępność funkcji podtrzymania zasilania, tzn. podczas zapadu zasilania UPS przechodzi na tryb pracy bateryjnej, jednakże po stronie odbiorników występuje przerwa w zasilaniu, która najczęściej powoduje wyłączenie się urządzeń IT i przerwanie ich usług,

- tryb pracy ECONversion – tryb pracy UPS z zasilaniem odbiorników poprzez by-pass, jednakże zaawansowane funkcje falownika będącego on-line pozwalają na jednoczesną korektą współczynnika mocy, korektą wyższych harmonicznych, z ładowaniem konserwującym (buforowym) baterii akumulatorów poprzez ładowarkę – w tym trybie pracy producenci podają najczęściej bardzo dobra sprawność (zbliżona do trybu ECO, tj. 98%...99% max.) / natychmiastowa dostępność podtrzymania zasilania nie wypływająca na ciągłość pracy urządzeń po stronie zasilania z UPS,

- tryb pracy w podwójnej konwersji (z zamianą postaci energii AC/DC - > DC/AC) – w tym trybie pracy producenci podają najczęściej sprawność w zakresie 94%...97% max./ natychmiastowa dostępność podtrzymania zasilania nie wypływająca na ciągłość pracy urządzeń po stronie zasilania z UPS,

- Tryb pracy w podwójnej konwersji z jednoczesnym ładowaniem zastawu akumulatorów po wystąpieniu incydentu zapadu zasilania - dodatkowy strumień ciepła będzie pochodzić od ładowarki podczas procesu ładowania akumulatorów.

- aktualne obciążenie zasilacza UPS które wpływa na sprawność UPS-s - co wynika z charakterystyki sprawności UPS w funkcji obciążenia. Charakterystyka sprawności w funkcji obciążenia UPS-a od 0% do 100% nie przebiega liniowo. Dane w postaci tabelarycznej lub wykres przebiegu sprawności w funkcji obciążenia jest do uzyskania w danych technicznych każdego UPS-a.

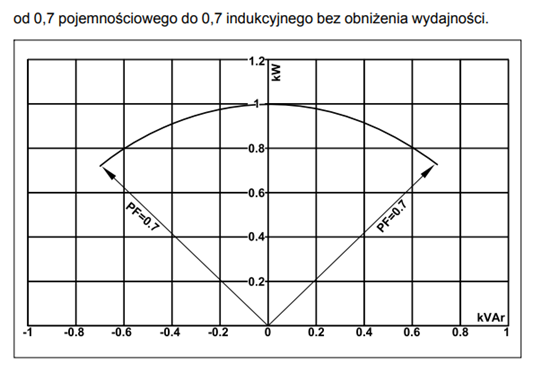

- Współczynnika mocy (PF) odbiorów z UPS - zgodnie z wykresem poniżej współczynnik mocy <1 wpływa na obniżenie mocy UPS wyrażonej w kVA

Przykład:

UPS o mocy 800kVA przy współczynniku mocy PF=0.9, dla mocy aktualnego obciążenia 80% daje aktualny punk pracy równy P = 800kVA * 0.9 = 576kW.

Sprawność UPS-a w trybie podwójnej konwersji (bez ładowarki) dla obciążenia 80% mocy nominalnej producent podaje na S = 97%. Zatem strumień ciepła Q = P * S = 576 kW * 97% = 17.8 kW

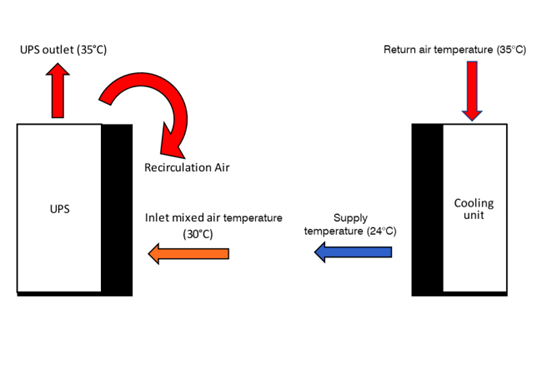

Do zapewnienia właściwych parametrów temperatury należy zapewnić właściwy strumień powietrza chłodzącego w ilości będącej pochodną różnicy temperatury powietrza na klimatyzatorze.

Przykład:

- Dla strumienia ciepła Q = 17.8 kW oraz strumienia powietrza chłodzącego w ilości 460 cfm / kW różnica temperatury na klimatyzatorze wyniesie około 3.8K.

- Dla strumienia ciepła Q = 17.8 kW oraz strumienia powietrza chłodzącego w ilości 200 cfm / kW różnica temperatury na klimatyzatorze wyniesie około 8.8K

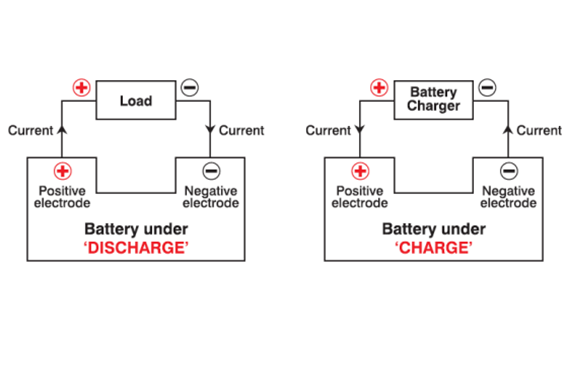

Tryby pracy zestawu baterii:

- Tryb rozładowania - bateria dostarcza energię do zasilania obciążenia zewnętrznego; W tym trybie bateria rozładowuje się i po powrocie zasilania następnie przechodzi do trybu ładowania.

- Tryb ładowania – zasilacz / ładowarka ładuje akumulator. Po naładowaniu baterii następuje tryb ładowania konserwującego (buforowego).

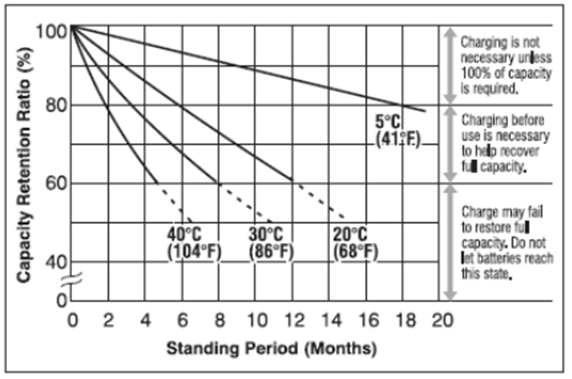

- Tryb ładowania konserwacyjnego (buforowego): - w trybie czuwania / gotowości, baterie mają tendencję do samorozładowanie. Aby utrzymać pojemność baterii, na jego zaciski podawane jest cyklicznie napięcie zwane napięciem konserwującym (buforowym), w celu utrzymanie akumulatora w stanie pełnego naładowania.

Podczas trybu rozładowania / ładowania jest wytwarzane ciepło będące następstwem zachodzących reakcji chemicznej egzotermicznej (ładowanie) lub endotermicznej (rozładowanie) oraz oporu wewnętrznego podczas przepływu prądu (ładowanie i rozładowanie).

Ciepło wytwarzane w akumulatorze zależy od prądu I (ładowania lub rozładowania) i rezystancji wewnętrznej „R”.

Wydzielone Ciepło podczas procesu ładowania lub rozładowania można określić w sposób następujący: Q = I * 2 * R

Ciepło wytwarzane podczas ładowania konserwującego (buforowego) można obliczyć używając wzoru V * I = Watów.

Należy zauważyć, że ciepło wytwarzane podczas trybu ładowania lub tryb rozładowania nie jest rozpraszane natychmiast

ze względu na pojemność cieplną materiałów, z których zbudowane są baterie.

Ciepło rozpraszane przez baterie zależy od jej wielkości, kształtu i rodzaju.

Uwaga: Ciepło wydzielane w czasie podczas rozładowania jest wyższe kilkukrotnie w stosunku do ciepła wytwarzanego podczas ładowania co jest pochodną rezystancji wewnętrznej oraz większego prądu płynącego podczas rozładowania.

Ilość ciepła wydzielanego podczas trybu rozładowania zależy również od czasu podtrzymania na który baterie zostały zwymiarowane. Ładowanie baterii jest procesem długotrwałym – najczęściej liczonym prądem 10 godzinnym, kiedy wydzielanie energii podczas rozładowania następuje w czasie zwykle kilku / kilkunastu minut.

Uwaga: Wskazane jest, aby każdorazowo zweryfikować parametry dobranych baterii w danych technicznych producenta

Przykład

- Zestaw 4 x UPS, każdy o mocy 400 kW, o sprawności 96%;

- Każdy zestaw baterii składa się z 3 łańcuchów, każdy składający się z 40 bloków po 200 Ah;

- Każda bateria o napięciu 12 V na blok (2 V na ogniwo, 6 komórki w bloku);

- Napięcie konserwujące (buforowe) dla każdego ogniwa wynosi 2,27 V;

- Czas podtrzymania wynosi 10 minut;

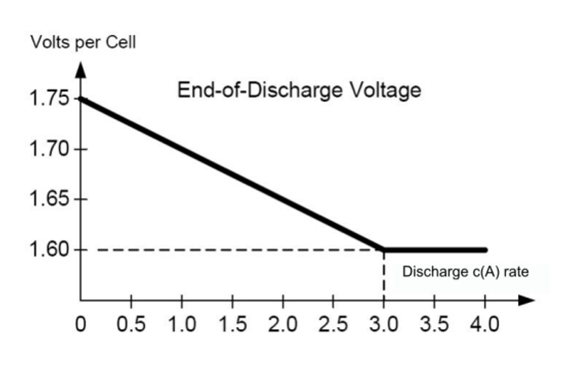

- Końcowe napięcie rozładowania (ogniwo) wynosi 1,75 V;

- Rezystancji każdego bloku akumulatorów 12 V wynosi 3,8 mΩ.

Oszacowanie wytwarzania ciepła podczas ładowania baterii VRLA

Oszacowanie wytwarzania ciepła podczas ładowania konserwującego (buforowego) można oprzeć o zapisy normy EN 50272.

Typowa wartość prądu ładowania jest określony na 1 mA na każdą 1Ah pojemności akumulatora.

- Prąd płynący na każdy łańcuch o pojemności 200 Ah = 200 mA

- Napięcie konserwujące (buforowe) każdego łańcucha wyniesie = 40 bloków × 6 komórek × 2,27 V = 544,8 V.

- Wytwarzanie ciepła na łańcuch wyniesie Waty = napięcie łańcucha (V) × prąd (A) = 544,8 V × 200 mA × 1/1000 = 109 W

- Stąd wytwarzane ciepło dla 3 łańcuchów wyniesie = 109 W × 3 = 327 W

- Dla 4 zestawów baterii w pomieszczeniu UPS, wytwarzanie ciepła od prądu konserwującego (buforowego) wyniesie 1308 W.

Wniosek: Wartość wydzielanego ciepła podczas ładowania konserwującego (buforowego) jest niewielka.

Oszacowanie wytwarzania ciepła podczas ładowania baterii VRLA

- Podczas ładowania, w przeciwieństwie do ładowania konserwującego (buforowego) – część energii elektrycznej jest przekształcone w ciepło oraz pozostała cześć zostaje przekształcone w energie chemiczną służącą do magazynowanie energii.

- Prąd ładowania jest zwykle ustawiony na 10% pojemności Ah przez producentów zasilaczy UPS. Dlatego prąd ładowania na jeden łańcuch wyniesie 0,1 A × 200 = 20 A.

- Opór każdego bloku baterii wynosi 3,8 mΩ.

- Rezystancja na jeden łańcuch z 40 blokami baterii wyniesie 40 × 3,8 mΩ = 152 mΩ = 0,152 Ω.

- Zyski ciepła wynikające ze wzoru wyniosą I2R = 20 × 20 × 0,152 = 60,8 W.

- Stąd zyski ciepła dla trzech łańcuchów = 3 × 60,8 W = 182,4 W

- Dla 4 zestawów UPS, wytwarzanie ciepła wyniesie 730 watów

Oszacowanie wytwarzania ciepła podczas rozładowania baterii VRLA

- Moc zasilacza UPS wynosi 400 kW, napięcie końcowe rozładowania wynosi 40 × 6 × 1,75 = 420 V,

- Sprawność falownika wynosi 96%.

- Prąd rozładowania = 400 × 1000 / (420 × 0,96) = 992 A

- Prąd rozładowania na łańcuch = 992 / 3 = 330,69 A.

- Straty ciepła na łańcuch = I2R = 330,69 A × 330,69 × 40 × 3,8 / 1000 = 16608 W = 16,61 kW.

- Straty ciepła dla trzech łańcuchów = 3 × 16,61 = 49,83 kW.

- Powyższe ciepło będzie generowane podczas rozładowania przyjętym czasie podtrzymania - 10 minut, a ciepło to będzie przekazywane do otoczenie w czasie, który dla ułatwienia przyjmiemy jako 10-krotne rozładowanie akumulatora. Wynika to z pojemności cieplnej samych baterii. Akumulator, a konkretnie akumulator kwasowo-ołowiowy, ma dużą masę. W rezultacie, chociaż proces przebiega szybko, ciepło jest odprowadzane do otoczenia przez długi czas.

- Stąd średnia emisja ciepła wyniesie = 49,83 × 10 / (10 ×10) = 5 kW.

- Dla czterech zestawów UPS emisja ciepła do otoczenie wyniesie = 5 kW × 4 = 20 kW.

Podsumowanie:

Proces ładowania konserwującego (buforowego) oraz ładowania baterii po rozładowaniu nie generuje tak dużego strumienia ciepła jak podczas ich rozładowania.

Projektant powinien zwymiarować system na przypadek wytwarzania ciepła podczas rozładowania baterii VRLA

Można zakładać, że w pomieszczeniu baterii będzie zainstalowane urządzenie nadmiarowe. W takim przypadku Projektant może przyjąć wykorzystanie mocy urządzeń podstawowych i nadmiarowych do odebrania strumienia ciepła w procesie rozładowania baterii VRLA. Działanie nadmiarowej jednostki klimatyzacyjnej będzie ograniczone w czasie, należy uzgodnić z Klientem ew. takie rozwiązanie.

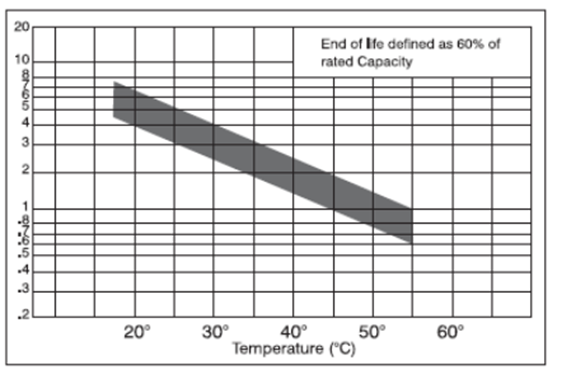

Dane techniczne baterii VRLA lub akumulatorów litowo-jonowych przeważne są podawane dla temperatury znamionowej 25°C. Należy brać po uwagę tą zależność, że chociaż pojemność baterii nieznacznie wzrasta wraz ze wzrostem temperatury, to jednocześnie ich żywotność zmniejsza się praktycznie o połowę na każde 8.3°C wzrostu temperatury powyżej 25 °C

Wymagania projektowe dotyczące chłodzenia akumulatorów Li-Jo

Inny rodzaj baterii, które są wykorzystywanych w data center to akumulatory litowo-jonowe (LIB), które mają znacznie szarszą tolerancję na zmiany temperatury otoczenia, nawet w granicach -20°C~60°C.

Jednak optymalny zakres temperatur pracy tych akumulatorów wynosi 15°C do 35°C. Zwiększenie temperatury roboczej LIB powyżej optymalnego zakresu prawdopodobnie przyspieszy starzenie baterii oraz może to zwiększyć ryzyko pożaru.

Właściwa temperatura otoczenia dla LIB ma kluczowe znaczenie dla wydajności i zachowania zasad bezpieczeństwa.

W pewnych okolicznościach, np. niewłaściwe obsługa lub wada produkcyjna, istnieje możliwość generowania dużej ilości ciepła wewnętrznego w poszczególnych celach LIB. Ten proces nazywa się ucieczką termiczną.

Wzrost temperatury wewnętrznej może prowadzić do spadku rezystancji wewnętrznej baterii. Zmiana oporu będzie również wpływać na moc baterii. Ucieczka termiczna baterii jest procesem nieodwracalnym i może w niektórych przypadkach doprowadzić do samozapłonu.

Monitorowanie temperatury wewnątrz LIB jest zatem krytyczne dla minimalizacji ryzyka. Teoretycznie wszystkie LIB są wyposażone we wbudowane układy BMS do ładowania oraz nadzoru temperatury.

Wymagania dotyczące wentylacji pomieszczenia baterii

Akumulator kwasowo-ołowiowy wytwarza wodór podczas ładowania. Jest to cecha charakterystyczna szczególnie dla akumulatorów zalanych, które posiadają cele otwarte wentylowane (VLA) – te akumulatory wymagające uzupełniania wody destylowanej z uwagi na wydzielanie się wodoru.

W przypadku akumulatorów zamkniętych regulowane zaworem (VRLA) istnieje możliwość wytwarzania i upuszczenia wodoru w przypadku przeładowania. Akumulatory LIB nie wytwarzają wodoru.

.

Celem zapewnienia wentylacji pomieszczenia baterii jest utrzymanie stężenia wodoru poniżej 4% wg objętość – co jest przyjętą dolną granicą wybuchowości mieszanki powietrza i wodoru (DGW). System wentylacji wyciągowej, ma zapewniać ciągłe ujemne ciśnienie w stosunku do sąsiednich pomieszczeń.

Minimalny przepływ powietrza dla wentylacja pomieszczenia akumulatorów powinien być obliczony zgodnie z poniższym wzorem ujętym w norie IEC 62485-2:2010:

Strumień powietrza wentylacyjnego: Q = v × q × s × n × Igas × Ah × 10-3 [m3/h],

Ilość wydzielanego wodoru: H = q × n × Igas × Ah × 10-3 [m3/h],

Gdzie:

- Q = przepływ powietrza wentylacyjnego w m³/h,

- H = całkowite wytwarzanie wodoru,

- v = niezbędne rozcieńczenie wodoru (100% - 4%) / 4% = 24,

- q = 0,42 × 10-3 m3 / Ah wytworzonego wodoru,

- s = 5, ogólny współczynnik bezpieczeństwa,

- n = liczba ogniw (2V),

- Igas = prąd wytwarzający gaz w mA na Ah znamionowa pojemność ładowania (Igas = 1 dla akumulatora VRLA pod ładowaniem konserwującym (buforowym))

- Ah = pojemność baterii.

Podstawiając za: v × q × s = 24 × 0,42 × 10-3 × 5 otrzymujemy wartość = 0,05 m3/Ah,

Zatem wzór na obliczenie przepływu powietrza wentylacyjnego przybierze postać:

Q = 0,05 × n × Igas × Ah × 10-3 [m3/h]

Przykład (ciąg dalszy z poprzednich rozważań):

Strumień powietrza wentylacyjnego podczas ładowania konserwującego (buforowego)

Rozmiar pomieszczenia baterii = 10m (długość) × 6m (szerokość) × 5m (wysokość) = 10 × 6 × 5 = 300 m3

Podstawiając dane pod formułę Q = 0,05 × n × Igas × Ah × 10-3 [m3/h].

Gdzie

- n = 4 (zestawy) × 3 (ciągi) × 40 (bloki) × 6 (liczba komórek/bloku) = 2880 komórek.

- Igas = 1 dla akumulatora VRLA

- Ah = 200.

Otrzymujemy zapotrzebowanie powietrza wentylacyjnego na godzinę = 28,8 m³/godz.

Liczba godzin potrzebnych na jedną wymianę powietrza = 300/28,8 = 10 godzin.

Jeżeli zapewnimy wentylator o wydajności 300 m3/h to tak dobrany wentylator będzie pracował przez godzinę co 10 godzin.

Ilość wydzielanego wodoru podczas ładowania konserwującego (buforowego)

Ze wzoru: H = q × n × Igas × Ah × 10-3 [m³/h]

Podstawiamy dane H = 0,42 × 10-3 × 2880 × 1 × 200 × 10-3 = 0,24 m³/godz.

Globalne trendy

Wzrost zapotrzebowania na usługi sieciowe jest efektem rozwoju społeczeństwa w dobie cyfryzacji, a także wyzwań strukturalnych stojących przed społeczeństwem cyfrowym.

Gigantyczny wzrost ruchu cyfrowego (informacyjnego) w Internecie jest niezaprzeczalnym faktem. Raport opracowany w 1994 r. przez Komisję Bangemanna pt. "Europa a globalne społeczeństwo informacyjne. Zalecenia dla Komisji Europejskiej" prognozował, że: "…kraje, które pierwsze wejdą w erę społeczeństwa informacyjnego będą rozwijać się najszybciej. To one wyznaczą drogę dla innych. Natomiast te kraje, które będą zwlekać, lub podejmą działania połowiczne, mogą w czasie krótszym od dziesięciolecia stanąć w obliczu załamania się inwestycji i kryzysu na rynku pracy". Prognozowane w raporcie zmiany właśnie dzieją się wokół nas a skala oraz proces zmian z roku na rok przyspieszają.

Kiedy społeczeństwo można nazwać „społeczeństwem cyfrowym”? Odpowiedź nie jest prosta, lecz można założyć, że linią graniczną jest osiągnięcie stopnia rozwoju procesów społecznych i gospodarczych wymuszających powszechne zastosowanie technik gromadzenia, przetwarzania, przekazywania i użytkowania olbrzymiej masy informacji generowanej przez owe procesy, a znaczna część dochodu narodowego brutto jest generowana dzięki zastosowaniu procesów informatycznych. W dzisiejszym świecie szybkość i ilość przetwarzania informacji są kluczowe dla osiągania wydajności i konkurencyjności, a także warunkują rozwój społeczny i przyrost zatrudnienia wpływając na zmianę formy organizacji pracy i wzory życia społecznego. Można zaryzykować twierdzenie, że wiele społeczeństw na świecie stały się już w znacznym stopniu „cyfrowe”.

Zauważalnie z roku na rok rośnie liczba użytkowników Internetu korzystających z coraz większej ilości usług biznesowych lub usług on-line, w tym cyfrowej administracji publicznej a produkcja i dystrybucja wszelkich produktów ściśle zależy od automatyzacji i informatyzacji. W roku 2014 ilość danych w ruchu cyfrowym rejestrowane przez dwa dowolne kolejne dni można było przyrównać z całym dorobkiem informacyjnym naszej cywilizacji wygenerowanym od jej początków do roku 2003 włącznie. Do roku 2020 ilość danych zgromadzonych przez ludzkość wzrośnie 10 krotnie i osiągnie niewyobrażalną wielkość około 44 ZB (1 ZB = 1021 bitów = 1 trylion gigabitów). Co ważniejsze, nastąpi wzrost użytecznych danych (takich, które są oznaczone i analizowane) z obecnych 22% do 35% w roku 2020. Nie tylko my się zmieniamy jako społeczeństwo. Dla wielu firm, to my staliśmy się obiektami generującymi dane do analizy zachowań jako jednostki społeczności oraz jako konsumenci.

Żyjemy w erze „BIG DATA”. Stale rośnie wielkość ruchu informatycznego w warstwie fizycznej i aplikacyjnej Internetu oraz masowo rośnie ilość rejestrowanych danych, przepustowości oraz moc obliczeniowa serwerów zarówno „własnych” dowolnego przedsiębiorstwa czy też kolokowanych w serwerowniach kolokacyjnych jak i w tzw. „chmurze”. Obecnie zarejestrowanych jest już ponad 2 miliardy użytkowników Internetu, ponad 21 miliardów urządzeń sieciowych, które dla zobrazowania samej skali obciążenia sieci, rejestrują ponad 1.3 milionów strumieni video na minutę. Należy również zauważyć ciągły wyścig technologiczny, jako że aplikacje wymagają coraz większej przepustowości, co jest związane z nowymi rodzajami usług (HDV-3D, gry on-line, Video-Calls, analiza obrazu, analiza głosu, itp.) oraz stale zwiększa się ilość urządzeń „smart” korzystających z zasobów Internetu on-line do rozrywki, zakupów, lokalizacji, rezerwacji, poczty…... Obserwuje się także stały wzrost ruchu cyfrowego związanego z tzw. Internetem rzeczy (IoT). Dla przykładu, średnio, godzina lotu samolotu pasażerskiego generuje 40TB danych / lot / godzinę.

Żyjemy w erze „BIG DATA”. Stale rośnie wielkość ruchu informatycznego w warstwie fizycznej i aplikacyjnej Internetu oraz masowo rośnie ilość rejestrowanych danych, przepustowości oraz moc obliczeniowa serwerów zarówno „własnych” dowolnego przedsiębiorstwa czy też kolokowanych w serwerowniach kolokacyjnych jak i w tzw. „chmurze”. Obecnie zarejestrowanych jest już ponad 2 miliardy użytkowników Internetu, ponad 21 miliardów urządzeń sieciowych, które dla zobrazowania samej skali obciążenia sieci, rejestrują ponad 1.3 milionów strumieni video na minutę. Należy również zauważyć ciągły wyścig technologiczny, jako że aplikacje wymagają coraz większej przepustowości, co jest związane z nowymi rodzajami usług (HDV-3D, gry on-line, Video-Calls, analiza obrazu, analiza głosu, itp.) oraz stale zwiększa się ilość urządzeń „smart” korzystających z zasobów Internetu on-line do rozrywki, zakupów, lokalizacji, rezerwacji, poczty…... Obserwuje się także stały wzrost ruchu cyfrowego związanego z tzw. Internetem rzeczy (IoT). Dla przykładu, średnio, godzina lotu samolotu pasażerskiego generuje 40TB danych / lot / godzinę.

Ten ruch w warstwie fizycznej jest obsługiwany w wielu węzłach, lecz na końcu każdego z nich znajduje się „serwerownia”.

W najbliższych latach (2016-2020) prognozuje się, że światowy rynek Data Center będzie rósł średnio w tempie 19.03% (CAGR).

Co to jest – Centrum Przetwarzania Danych

Ścisłą definicję Centrum Przetwarzania Danych podaje norma PN-EN 50600-1 (pkt.3.1.9) - „Budowla lub zespół budowli przeznaczone do zgrupowania pomieszczeń, połączeń i obsługi urządzeń techniki informacyjnej oraz sprzętu sieci telekomunikacyjnych zapewniających usługi przechowywania, przetwarzania i dostarczania danych wraz z pełnym wyposażeniem i infrastrukturą do dystrybucji energii i zapewnienia parametrów środowiskowych oraz koniecznego poziomu odporności i zabezpieczeń wymaganych w celu zapewnienia pożądanej dostępności usług”.

W języku potocznym w miejsce przyjętego w normie PN-EN 50600-1 pojęcia „Centrum Przetwarzania Danych” używane są bardzo często zamiennie pojęcia „Data Center” i „serwerownia”.

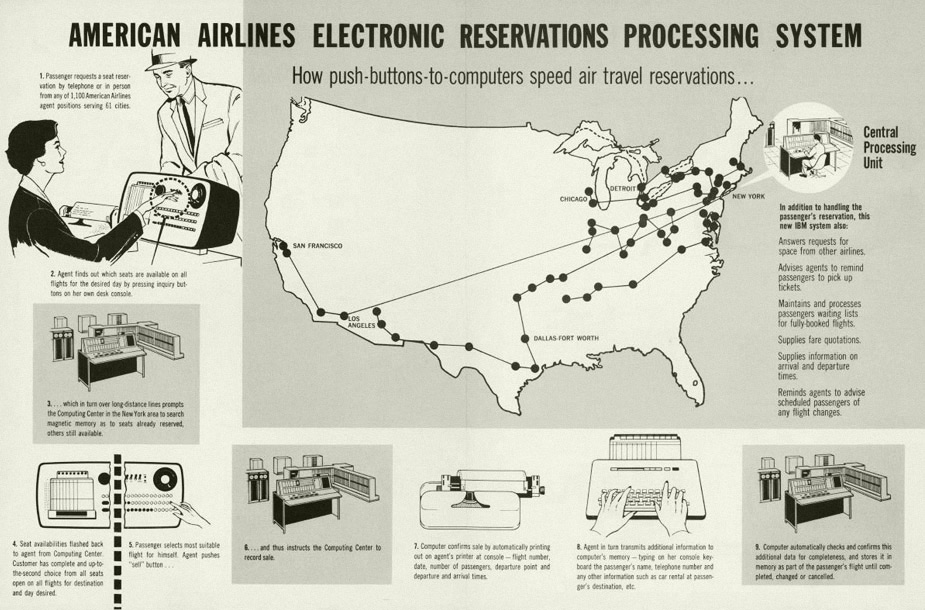

Pojęcie "serwerownia" powstało w końcu lat 50-tych, podczas wspólnej realizacji projektu American Airlines i IBM nawiązały współpracę dla stworzenia systemu rezerwacji miejsc w oparciu o rozwiązanie informatyczne firmy Sabre. Od tego czasu, zmiany strukturalne wykorzystania informatyzacji oraz możliwości technologiczne w dziedzinie przetwarzania i przechowywania danych doprowadziły do rozwiązań, które z jednej strony nadążają za zwiększającymi się wymaganiami użytkowników z drugiej generują coraz to większe możliwości związane tymi usługami np. na urządzeniach mobilnych.

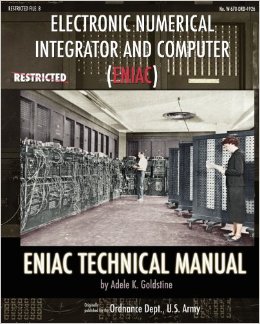

Należy zauważyć, że w tym roku mija właśnie 70 lat od budowy pierwszego komputera - Electronic Numerical Integrator and Computer (ENIAC), który w 1946 roku służył „US Army” do przechowywania kodów artyleryjskich. Dzisiejsze serwerownie są w większości projekcją wymagań modelu usług w którym obserwujemy przesunięcia z modelu „własności infrastruktury”, na którą składają się: sprzęt i oprogramowanie, instalacje techniczne (zasilanie i chłodzenie) w stronę subskrypcji pojemności i mocy obliczeniowej dla dostępu do oczekiwanych przez biznes i konsumenta usług. Korzystający z zasobów Internetu przeważnie nie interesują się skąd pobierają dane, podobnie jak niewiele osób zwraca uwagę, że za gniazdkiem elektrycznym jest schowana elektrownia, a czasami także i kopalnia węgla.

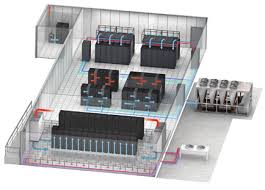

Jak zbudowana jest tradycyjna serwerownia? Jest ona budynkiem lub jego częścią, na którą składa się komora serwerów, w której instalowany jest sprzęt IT oraz pomieszczenia i obszary wspierające jej funkcjonalność, w tym pomieszczenia np.: UPS, dystrybucji energii, techniczne, telekomunikacyjne, operacyjne, pomieszczenia dystrybucji chłodu oraz obszary posadowienia agregatów prądotwórczych, agregaty chłodu, zbiorniki paliwa, itp. Wszystkie te urządzenia / systemy techniczne zwane infrastrukturą dzieli się na infrastrukturę informatyczną oraz infrastrukturę techniczną.

Na Infrastrukturę Informatyczną składają się wszystkie urządzenia systemów komputerowych, w tym urządzenia aktywne i pasywne sieciowe, serwery i pamięci masowe, wraz z okablowaniem logicznym miedzianym i światłowodowym, przyłączami telekomunikacyjnymi, której działanie jest niezbędne do osiągnięcia celu biznesowego jakiemu towarzyszy działanie serwerowni Infrastruktura Techniczna – to maszyny, urządzenia, systemy i instalacje techniczne, w szczególności systemy i instalacje elektroenergetyczne i teletechniczne oraz systemy i instalacje mechaniczne związane głównie z utrzymaniem właściwych parametrów środowiska pracy systemów informatycznych (wilgotność i temperatura), właściwych dla bezpiecznego użytkowania systemów IT, np. zgodnie z zaleceniami producentów lub niezależnych instytucji standaryzacyjnych np. ASHRAE (Amerykańskie Stowarzyszenie Inżynierów Ogrzewnictwa Chłodzenia i Klimatyzacji). Infrastruktura techniczna może być oparta o różne technologie, bardziej lub mniej przyjazne środowisku a także zarządzania w sposób sprzyjający minimalizujące zużycia energii, szczególnie jeśli serwerownia nie osiąga nominalnego (tzn. obliczeniowego) obciążenia (tzn. wykorzystania), czyli powierzchnia serwerowni jest niedociążona. W takim przypadku wskaźnik PUE może osiągać bardzo niezadowalające wyniki a koszty eksploatacji jednostkowo rosną. W przypadku eksploatacji serwerowni może istnieć wiele strategii regulacji powodujących minimalizowanie zużycie energii opartych o centralne systemy zarządzania i oprogramowanie klasy DCIM (Data Center Infrastructure Management). W zależności od obciążenia serwerowni oraz występujących warunków atmosferycznych strategie będą realizować algorytmy maksymalizacji wykorzystania freecolingu, czyli wykorzystania naturalnego potencjału środowiska do chłodzenia środowiska pracy systemów informatycznych przy minimalnym udziale systemów wytwarzania chłodu w sposób mechaniczny (sprężarkowy z wykorzystaniem cieczy niskowrzących oraz procesów termodynamicznych przekazujących ciepło ze źródeł o wyższej temperaturze do źródeł o niższej temperaturze).

Infrastruktura Techniczna – to maszyny, urządzenia, systemy i instalacje techniczne, w szczególności systemy i instalacje elektroenergetyczne i teletechniczne oraz systemy i instalacje mechaniczne związane głównie z utrzymaniem właściwych parametrów środowiska pracy systemów informatycznych (wilgotność i temperatura), właściwych dla bezpiecznego użytkowania systemów IT, np. zgodnie z zaleceniami producentów lub niezależnych instytucji standaryzacyjnych np. ASHRAE (Amerykańskie Stowarzyszenie Inżynierów Ogrzewnictwa Chłodzenia i Klimatyzacji). Infrastruktura techniczna może być oparta o różne technologie, bardziej lub mniej przyjazne środowisku a także zarządzania w sposób sprzyjający minimalizujące zużycia energii, szczególnie jeśli serwerownia nie osiąga nominalnego (tzn. obliczeniowego) obciążenia (tzn. wykorzystania), czyli powierzchnia serwerowni jest niedociążona. W takim przypadku wskaźnik PUE może osiągać bardzo niezadowalające wyniki a koszty eksploatacji jednostkowo rosną. W przypadku eksploatacji serwerowni może istnieć wiele strategii regulacji powodujących minimalizowanie zużycie energii opartych o centralne systemy zarządzania i oprogramowanie klasy DCIM (Data Center Infrastructure Management). W zależności od obciążenia serwerowni oraz występujących warunków atmosferycznych strategie będą realizować algorytmy maksymalizacji wykorzystania freecolingu, czyli wykorzystania naturalnego potencjału środowiska do chłodzenia środowiska pracy systemów informatycznych przy minimalnym udziale systemów wytwarzania chłodu w sposób mechaniczny (sprężarkowy z wykorzystaniem cieczy niskowrzących oraz procesów termodynamicznych przekazujących ciepło ze źródeł o wyższej temperaturze do źródeł o niższej temperaturze).

Koszty posiadania własnej infrastruktury (koszty posiadania Data Center)

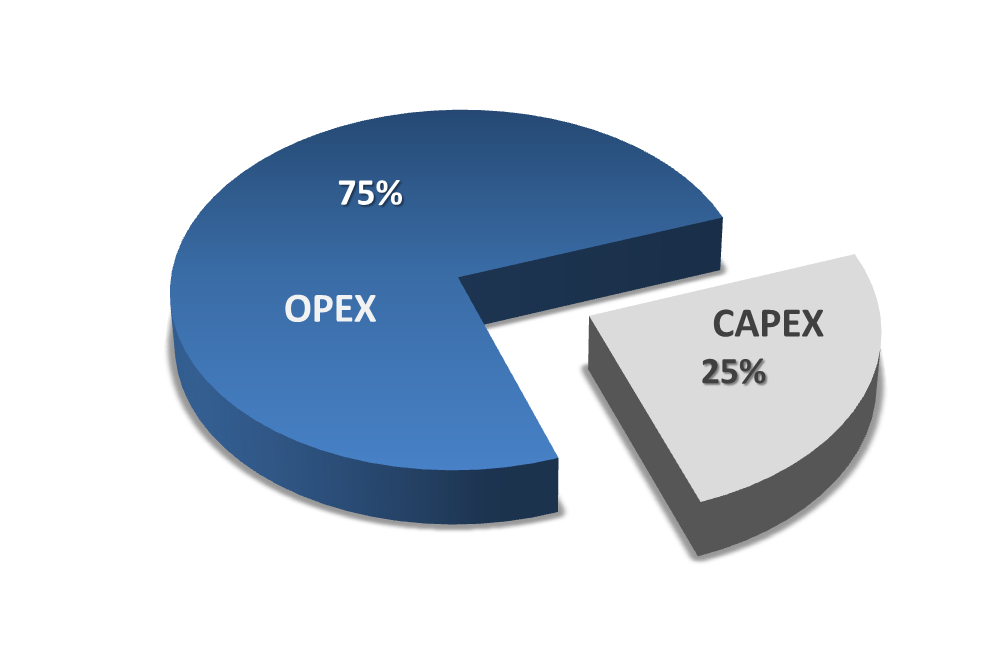

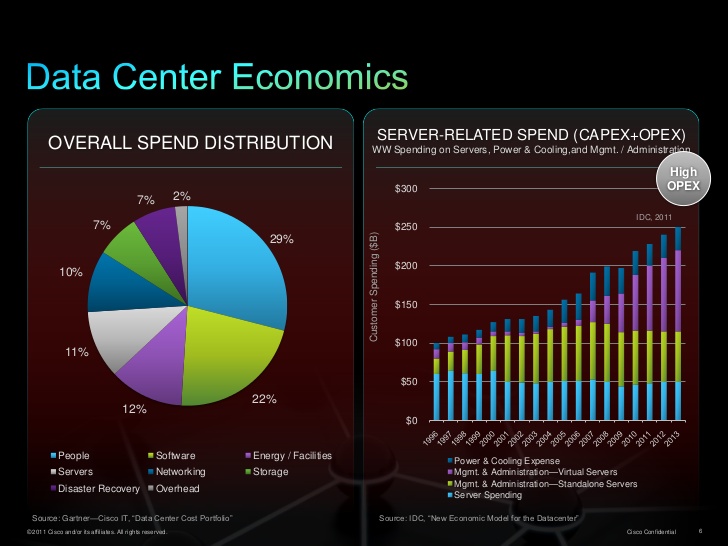

W przypadku Klientów biznesowych, użytkujących do tej pory własną infrastrukturę IT, najczęstszym powodem tych zmian są koszty, które można podzielić na koszty inwestycyjne (CAPEX – Capital Expences) – związany z budową infrastruktury lub wymianami wymuszonymi przez postęp technologiczny, i koszty utrzymania (OPEX – Operating Expences), przy czym większość wydatków jest jednak związana z bieżącym utrzymaniem infrastruktury i dostępu do jej usług.

Na wielkość OPEX największy wpływ ma koszt i ilość zużywanej energii. W roku 2010 serwerownie zużywały 1,1-1,5% światowej produkcji energii, a w ostatnich latach roczny trend wzrostowy notował średnio 7% (a regionalnie nawet 30%) wzrostu zużycia energii przez IT. Obecnie, szacuje się, że serwerownie odpowiadają za zużycie około 3%, a cała branża IT i Telecom za zużycie około 11% światowej produkcji energii elektrycznej wynoszącej obecnie około 25 000 TWh. Prognozy zakładają także, że w następnej dekadzie zużycie energii przez branże IT zostanie potrojone. Intensywnie eksploatowany „smartfon” zużywa rocznie porównywalnie tyle energii jak mała domowa lodówka, co więcej, za usługami związanymi z „smart” telefonu komórkowego kryją się inne węzły infrastruktury technicznej zużywające gigantyczne ilości energii.

Bezpieczeństwo danych, ciągły dostęp do usług

W związku z powszechnym zastosowaniem informatyki i przetwarzania danych we wszystkich aspektach życia społecznego, aktywności gospodarczej oraz administracji publicznej, zapewnienie ciągłego dostępu do usług biznesowych serwerowni a także bezpieczeństwo danych stało się krytyczne. Dostosowanie infrastruktury do wymagań wysokiej niezawodności i dostępności danych stało się nową dziedziną techniki podlegającą procesowi kwalifikacji i certyfikacji. Na rynku amerykańskim zostały zawiązane komercyjne ciała doradcze, np. Uptme Institute, Building Industry Consulting Service International (BICSI) oraz normalizacyjne, Telecommunications Industry Association (TIA). W 2016 Europejski Komitet Normalizacyjny Elektrotechniki (CENELEC) zakończył etap prac polegający na stworzeniu grupy norm EN 50600 „Data Centre Infrastructure and Facilities”. Jest to obszerna, w zasadzie pierwsza na świecie, seria dokumentów normalizacyjnych obejmujących w pełni wszystkie aspekty funkcjonowania centrów przetwarzania danych pod kątem wymogów infrastrukturalnych. Zawiera zarówno elementy klasyfikacji niezawodności, metody projektowania jak również elementy opisujące właściwą eksploatację ja też zapewnienie efektywności energetycznej. Normy te doskonale współgrają z opracowaniami normalizacyjnymi takimi jak ISO/IEC 20000 (zarządzanie usługami IT), ISO/IEC 27001 opisującej wymogi bezpieczeństwa informacji i ciągłości przetwarzania (ISO 22301).

Dzisiejsze centra przetwarzania danych w zakresie zapewnienia niezawodnej pracy urządzeń IT cechuje przede wszystkim bezpieczeństwo (określenie jako dostępność lub niezawodność) oparte o rozwiązania techniczne (głównie wielowymiarową redundancje urządzeń i systemów infrastruktury oraz bezpieczeństwo i ciągłość zasilania i chłodzenia) oraz restrykcyjne procedury związane z kompetencjami personelu, procedurami eksploatacyjnymi oraz remontowymi a także procedury wprowadzania zmian. Lokalizacja serwerowni jest starannie rozpatrywana, nie tylko pod względem dostępności do mediów, dostępności do pasma, odległości wpływającej na notowane w aplikacjach opóźnienia, ale także ze względu na fizyczne bezpieczeństwo danych.

Realia rynku polskiego

Polski rynek usług Data Center jest głównie nastawiony na:

• usługi dostępu do infrastruktury ICT (technologie informacyjno-komunikacyjne)

• usługi zarządzania infrastrukturą

• usługi zarządzania i udostępniania oprogramowania

• usługi dodane i outsourcing

Na polskim rynku wciąż obserwuje się stosunkowo niskie nasycenie przy jednoczesnej dużej dynamice wzrostu i rozwoju z czego największe nasycenie wykazuje Województwo Mazowieckie. Szacuje się, że w Polsce obecnie jest około 100 000 – 120 000 m2 powierzchni komór serwerowych netto łącznie, przy czym większość serwerowni ma powierzchnię poniżej 100 m2 i jednocześnie powstał do tej pory jeden obiekt (2016) o powierzchni netto komór razem większej niż 4000 m2. Obserwowana dynamika wzrostu rynku podaży Data Center wyniosła 2014 roku 11,1% (YTY) a w 2015 roku 10,3% (YTY) a stopa zwrotu kapitału zainwestowanego w serwerownie ma tendencje spadkową. Prognozuje się dalszy spadek dynamiki przyrostu powierzchni kolokacyjnej do 6.7% do roku 2021. Powodem tego jest trend obniżania cen usług kolokacji obserwowany od roku 2013. Wciąż nie zagospodarowane pozostaje około 1/3 powierzchni netto powierzchni przeznaczonej na usługi kolokacji. Cena kolokacji pojedynczej szary RACK na przestrzeni lat 2014-2016 spadła średnio o 237 złotych netto.

Analizując wielkość dostępnej komercyjnej powierzchni kolokacyjnej w serwerowniach, należy zauważyć że według analizy rynku na rok 2015 łączna powierzchnia komór serwerowych przekroczyła 55 tysięcy m2, z tendencją rocznego przyrostu rzędu 3-5 tysięcy m2 notowanej na przestrzeni ostatnich 7 lat.

Szacuje się również, że w 2015 zajętość dostępnej powierzchni komercyjnych centrów danych sięgnęła 60%, przy czym analiza dotyczy obiektów o powierzchni powyżej 500 m2 powierzchni komory, których jest w Polsce w roku 2016 było łącznie 86 obiektów.

Należy także odnotować duże rozdrobnienie obiektów. W roku 2015 serwerowni komercyjnych posiadających łącznie powyżej 1000 m2 powierzchni było jedynie 14 obiektów.

Należy jednocześnie odnotować zwiększające się zainteresowanie światowych potentatów rynkiem polskim kolokacji czy usług w „chmurze”. Świadczy o tym m-in. kapitałowe przejęcia rodzimych firm przez światowych potentatów. Przykładem jest przejęcie firmy lokalnej firmy PLIX przez Telecity a następnie przez Equinix czy poszukiwanie strategicznego Inwestora przez ATMan po nieudanej próbie przejęcia przez fundusz inwestycyjny Innova Capital. W 2015 roku 17 procent wszystkich danych było przetwarzanych we własnych serwerowniach (wirtualne lub zarządzane w ramach prywatnej chmury) – wzrost o1,4% w stosunku do roku 2014. Tymczasem 10,4 procent wszystkich RACK zostało „outsorsowane” w chmurze. Oznacza wzrost o 0,8% w stosunku do roku 2014. Obecnie wartość rynku usług Data Center jest szacowana na 1,15 mld zł (z czego 390 mln kolokacje), Prognoza wzrostu rynku szacuje wzrost usług Data Center do roku 2018 do poziomu około ~ 2 mld zł.

Szansą dla pomyślnego zainwestowania pieniędzy Skarbu państwa w rynek Data Center jest Strategia "Sprawne Państwo 2020„ - podniesienie sprawności i efektywności działania administracji publicznej na rzecz obywatela i szeroką z nim współpracę - przy wykorzystaniu nowoczesnych technologii informacyjno-komunikacyjnych (m.in. sprawną komunikacją i wymianą dokumentów) mające na celu:

Szansą dla pomyślnego zainwestowania pieniędzy Skarbu państwa w rynek Data Center jest Strategia "Sprawne Państwo 2020„ - podniesienie sprawności i efektywności działania administracji publicznej na rzecz obywatela i szeroką z nim współpracę - przy wykorzystaniu nowoczesnych technologii informacyjno-komunikacyjnych (m.in. sprawną komunikacją i wymianą dokumentów) mające na celu:

o zwiększeni konkurencyjności i innowacyjności gospodarki,

o zwiększenie efektywności i sprawności państwa,

o wyrównywanie różnic w poziomie rozwoju województw.

Strategia informatyzacji i wyrównywania szans w dobie społeczeństwa cyfrowego została przełożona na szereg strategii operacyjnych do których należą m.in.:

• Strategia innowacyjności i efektywności gospodarki (Ministerstwo Gospodarki),

• Strategia rozwoju kapitału ludzkiego (Ministerstwo Pracy i Polityki Społecznej),

• Strategia rozwoju transportu (Ministerstwo Infrastruktury i Rozwoju),

• Strategia Bezpieczeństwo energetyczne i środowisko (Ministerstwo Gospodarki),

• Strategia Sprawne państwo (Ministerstwo Administracji i Cyfryzacji),

• Strategia rozwoju kapitału społecznego (Ministerstwo Kultury i Dziedzictwa Narodowego),

• Krajowa strategia rozwoju regionalnego - miasta i obszary wiejskie (Ministerstwo Infrastruktury i Rozwoju),

• Strategia zrównoważonego rozwoju wsi, rolnictwa i rybactwa (Ministerstwo Rolnictwa i Rozwoju Wsi),

• Strategia rozwoju systemu bezpieczeństwa narodowego RP (Ministerstwo Obrony Narodowej).

a także programy operacyjne, m.in.:

• Program Operacyjny „Innowacyjna Gospodarka”

• Program Operacyjny „e-administracja” – jeden priorytetów Unii Europejskiej w sferze cyfrowej - zasada jednorazowego pobierania danych przez administrację tj. zapewnienie, że administracja publiczna wykorzystuje wielokrotnie informacje o obywatelu lub przedsiębiorstwie, które są już do jej dyspozycji.

• Program rozwoju sieci i usług telekomunikacyjnych.

• Program e-zdrowie (cyfryzacja danych medycznych – do 2017 roku)

Wszystkie te programy i strategie generują duże potrzeby Państwa w zakresie budowy i utrzymania ruchu Data Center. Według analiz rynku serwerowni w Polsce, Administracja Państwowa jest jednym z głównych motorów powstawania nowych obiektów. Obserwowany obecnie trend ciągłego wzrostu agregowanych, przetwarzanych i przechowywanych danych jak również przenoszenie zasobów do „chmury obliczeniowej” będzie przyczyniał się do zwiększania zapotrzebowania na dostęp do nowoczesnej infrastruktury IT lokowanej w serwerowniach. Szacuje się, że w 2015 roku jedynie 13% zasobów Administracji Publicznej oraz 8% Administracji Samorządowej było kolokowanych. Tak więc potrzeby te są jedynie częściowo zaspokajane przez usługodawców oferujących usługi kolokacji. Jak wynika z informacji przekazywanych przez Ministerstwo Cyfryzacji potrzeby Państwa w tym zakresie są nadal ogromne, i co więcej w opinii rządzących - są zaniedbane. Cytat. „Niedawna awaria ePUAP przypomniała nam wszystkim, że w Polsce jest pewien poważny problem z informatyzacją administracji publicznej. Systemy stworzone za miliony złotych mogą służyć tylko tysiącom, setkom, a czasem nawet tylko dziesiątkom obywateli. Co gorsza, te systemy są mocno zawodne toteż nic dziwnego, że wielu Polaków nadal preferuje osobisty kontakt z urzędnikiem. Wciąż wielu z nas nie wierzy, że da się załatwiać sprawy w urzędzie przez Internet” oraz „Na ironię zakrawa fakt, że dokument „Program Zintegrowanej Informatyzacji Państwa” przyjęty został przez Radę Ministrów 8 stycznia 2014r., a więc po już po zakończeniu perspektywy budżetowej 2007-2013, (...) i po rozpoczęciu wydatkowania środków we wszystkich projektach informatycznych finansowanych z osi 7 POIG, co spowodowało, że dokument ten miał wartość jedynie deklaratywną (zbiór pobożnych życzeń oraz wskazówek jak nie należy informatyzować administracji publicznej)”

W roku 2012, gdy powstało pierwsze ministerstwo cyfryzacji, ówczesny rząd zapowiadał uporządkowanie "stajni augiasza". Niestety jak ocenia to nowy rząd, nie udało się tego zrobić, a teraz przed tym zadaniem stoi kolejna osoba - minister Anna Streżyńska. W wystąpieniu Pani minister podaje liczby:

• 4 miliardy złotych - tyle przeznaczono na realizację projektów z zakresu budowy elektronicznej administracji.

• 3,4 mld złotych pochodziło ze środków UE.

• 600 mln złotych wynosił wkład krajowy, a więc tyle daliśmy na to wszyscy.

Dodatkowo można przytoczyć następujące słowa Pani minister:

Dodatkowo można przytoczyć następujące słowa Pani minister:

” Jeżeli ktoś zajmuje się informatyzacją w sektorze publicznym, musi być przygotowany na to, że jego chlebem codziennym będą oskarżenia o przekręty. Nawet jeżeli będzie uczciwy. Dzisiaj połowa tych zasobów, które zbudowano za pieniądze z poprzedniej unijnej perspektywy budżetowej, stoi niewykorzystana, podczas gdy wnioski do nowego programu operacyjnego Polska Cyfrowa, które do mnie trafiły, czterokrotnie przewyższają to, co jest do dyspozycji. I proszę sobie wyobrazić, że prawie w każdym z nich jest mowa o budowie serwerowni.”

Pani minister stwierdziła również, że Państwo nie wykorzystuje efektu skali „…brak możliwości wykorzystania efektu skali i uzyskania oszczędności przy nabywaniu urządzeń i technologii IT, pomijanie przez resorty efektów wdrożeń w innych resortach, brak poszukiwania efektów synergii w skali całej administracji publicznej. W efekcie środki publiczne były wydawane chaotycznie i w sposób daleki od efektywności".

Podsumowanie i wnioski

Wspomniany efekt skali jest w przypadku centrów przetwarzania danych wart szczególnej uwagi. Państwo przetwarza olbrzymie ilości danych w celu zaspokajania potrzeb obywateli jak również na potrzeby własne i swojego bezpieczeństwa. Wymaga to wielkich zasobów infrastruktury centrów danych. Wydaje się bezdyskusyjne, że w tym wypadku efekt skali powinien zostać wykorzystany do prowadzenia jednolitej oraz scentralizowanej polityki w zakresie potrzeb IT w skali Państwa. Inną zupełnie kwestią jest ciągły rozwój podaży powierzchni kolokacyjnej oraz usług "cloudowych".

Zapraszamy do dyskusji.

Autorzy:

mgr inż. Krzysztof Szczygieł.

mgr inż. Inż. Paweł Wróbel

Nie ma wątpliwości, że jedną z najważniejszych decyzji towarzyszących budowie centrum danych jest wybór lokalizacji. Dostęp do sieci i koszty energii elektrycznej, łączność, bezpieczeństwo, warunki pogodowe i topografi czne – to wszystko składa się na decyzję o zlokalizowaniu serwerowni. Dlaczego w takim razie ktokolwiek chciałby budować centrum danych w opuszczonej kopalni węgla, głęboko we wnętrzu góry lub na środku pustyni?

Wstęp

Gigantyczny wzrost ruchu cyfrowego (informacyjnego) w Internecie jest niezaprzeczalnym faktem. Raport opracowany w 1994 r. przez Komisję Bangemanna pt. "Europa a globalne społeczeństwo informacyjne. Zalecenia dla Komisji Europejskiej" prognozował, że: "…kraje, które pierwsze wejdą w erę społeczeństwa informacyjnego będą rozwijać się najszybciej. To one wyznaczą drogę dla innych. Natomiast te kraje, które będą zwlekać, lub podejmą działania połowiczne, mogą w czasie krótszym od dziesięciolecia stanąć w obliczu załamania się inwestycji i kryzysu na rynku pracy". Prognozowane w raporcie zmiany właśnie dzieją się wokół nas a skala oraz proces zmian z roku na rok przyspieszają.

Kiedy społeczeństwo można nazwać „społeczeństwem cyfrowym”? Odpowiedź nie jest prosta, lecz można założyć, że linią graniczną jest osiągnięcie stopnia rozwoju procesów społecznych i gospodarczych wymuszających powszechne zastosowanie technik gromadzenia, przetwarzania, przekazywania i użytkowania olbrzymiej masy informacji generowanej przez owe procesy, a znaczna część dochodu narodowego brutto jest generowana dzięki zastosowaniu procesów informatycznych. W dzisiejszym świecie szybkość i ilość przetwarzania informacji są kluczowe dla osiągania wydajności i konkurencyjności, a także warunkują rozwój społeczny i przyrost zatrudnienia wpływając na zmianę formy organizacji pracy i wzory życia społecznego. Można zaryzykować twierdzenie, że wiele społeczeństw na świecie stały się już w znacznym stopniu „cyfrowe”.

Zauważalnie z roku na rok rośnie liczba użytkowników Internetu korzystających z coraz większej ilości usług biznesowych lub usług on-line, w tym cyfrowej administracji publicznej a produkcja i dystrybucja wszelkich produktów ściśle zależy od automatyzacji i informatyzacji. W roku 2014 ilość danych w ruchu cyfrowym rejestrowane przez dwa dowolne kolejne dni można było przyrównać z całym dorobkiem informacyjnym naszej cywilizacji wygenerowanym od jej początków do roku 2003 włącznie. Do roku 2020 ilość danych zgromadzonych przez ludzkość wzrośnie 10 krotnie i osiągnie niewyobrażalną wielkość około 44 ZB (1 ZB = 1021 bitów = 1 trylion gigabitów). Co ważniejsze, nastąpi wzrost użytecznych danych (takich, które są oznaczone i analizowane) z obecnych 22% do 35% w roku 2020. Nie tylko my się zmieniamy jako społeczeństwo. Dla wielu firm, to my staliśmy się obiektami generującymi dane do analizy zachowań jako jednostki społeczności oraz jako konsumenci. Wkroczyliśmy zatem w erę „BIG DATA”.

Stale rośnie wielkość ruchu informatycznego w warstwie fizycznej i aplikacyjnej Internetu oraz masowo rośnie ilość rejestrowanych danych, przepustowości oraz moc obliczeniowa serwerów zarówno „własnych” dowolnego przedsiębiorstwa czy też kolokowanych w serwerowniach kolokacyjnych jak i w tzw. „chmurze”. Obecnie zarejestrowanych jest już ponad 2 miliardy użytkowników Internetu, ponad 21 miliardów urządzeń sieciowych, które dla zobrazowania samej skali obciążenia sieci, rejestrują ponad 1.3 milionów strumieni video na minutę. Należy również zauważyć ciągły wyścig technologiczny, jako że aplikacje wymagają coraz większej przepustowości, co jest związane z nowymi rodzajami usług (HDV-3D, gry on-line, Video-Calls, analiza obrazu, analiza głosu, itp.) oraz stale zwiększa się ilość urządzeń „smart” korzystających z zasobów Internetu on-line do rozrywki, zakupów, lokalizacji, rezerwacji, poczty…... Obserwuje się także stały wzrost ruchu cyfrowego związanego z tzw. Internetem rzeczy (IoT). Dla przykładu, średnio, godzina lotu samolotu pasażerskiego generuje 40TB danych / lot / godzinę.

Ten ruch w warstwie fizycznej jest obsługiwany w wielu węzłach, lecz na końcu każdego z nich znajduje się „serwerownia”.

Data Center - serwerownia

Pojęcie "serwerownia" powstało w końcu lat 50-tych, podczas wspólnej realizacji projektu American Airlines i IBM nawiązały stworzenia systemu rezerwacji miejsc w oparciu o rozwiązanie informatyczne firmy Sabre. Od tego czasu, zmiany strukturalne wykorzystania informatyzacji oraz możliwości technologiczne w dziedzinie przetwarzania i przechowywania danych doprowadziły do rozwiązań, które z jednej strony nadążają za zwiększającymi się wymaganiami użytkowników z drugiej generują coraz to większe możliwości związane tymi usługami. Czy wyobrażacie sobie obecnie dziś życie bez Internetu, „smartfona”/”tabletu” czy komputera?

Należy zauważyć, że w tym roku mija właśnie 70 lat od budowy pierwszego komputera - Electronic Numerical Integrator and Computer (ENIAC), który w 1946 roku służył „US Army” do przechowywania kodów altyreryjskich. Dzisiejsze serwerownie ze swą mnogością urządzeń IT są w większości projekcją wymagań modelu usług w którym obserwujemy przesunięcia z modelu „własności infrastruktury”, na którą składają się: sprzęt i oprogramowanie, instalacje techniczne (zasilanie i chłodzenie) w stronę subskrypcji pojemności i mocy obliczeniowej dla dostępu do oczekiwanych przez biznes i konsumenta usług. Korzystający z zasobów Internetu przeważnie nie interesują się skąd pobierają dane, podobnie jak niewiele osób zwraca uwagę, że za gniazdkiem elektrycznym jest schowana elektrownia, a czasami także i kopalnia węgla.

W przypadku Klientów biznesowych, użytkujących do tej pory własną infrastrukturę IT, najczęstszym powodem tych zmian są koszty, które można podzielić na koszty inwestycyjne (CAPEX – Capital Expences) – związany z budową infrastruktury lub wymianami wymuszonymi przez postęp technologiczny, i koszty utrzymania (OPEX – Operating Expences), przy czym większość wydatków jest jednak związana z bieżącym utrzymaniem infrastruktury i dostępu do jej usług.

Na wielkość OPEX największy wpływ ma koszt i ilość zużywanej energii. W roku 2010 serwerownie zużywały 1,1-1,5% światowej produkcji energii, a w ostatnich latach roczny trend wzrostowy notował średnio 7% (a regionalnie nawet 30%) wzrostu zużycia energii przez IT. Obecnie, szacuje się, że serwerownie odpowiadają za zużycie około 3%, a cała branża IT i Telecom za zużycie około 11% światowej produkcji energii elektrycznej wynoszącej obecnie około 25 000 TWh. Prognozy zakładają także, że w następnej dekadzie zużycie energii przez branże IT zostanie potrojone. Czy ktoś na co dzień zwraca uwagę, że intensywnie eksploatowany „smart fon” zużywa rocznie więcej energii niż średniej wielkości domowa lodówka? A za usługami związanymi z „smart” telefonu komórkowego kryją się inne węzły infrastruktury technicznej zużywające gigantyczne ilości energii.

W obliczu rosnących cen energii oraz pogłębiających się zmian w klimacie ziemi coraz większą uwagę zaczynamy przykładać do minimalizacji zużycia energii oraz efektywność energetyczną urządzeń i systemów. Nie inaczej dzieje się także w przypadku serwerowni. Należy pamiętać, że energia zużyta przez sprzęt IT do pełnienia funkcji do której zostały stworzone w większości zamieniają się na które w serwerowni musi zostać odebrana oraz przetransportowana na zewnątrz jego struktury budowlanej do atmosfery. Najczęściej na każdy 1kW energii zużytej przez urządzenia IT, zużywa się dodatkowo około 1,1 do nawet ponad 2 kW energii na chłodzenie i bezpieczne podtrzymanie zasilania. Efektywność tego procesu określa średnioroczny współczynnik PUE – (ang. Power Usage Effectiveness) określający proporcje całej energii elektrycznej zużywanej na zasilanie serwerowni do energii elektrycznej zużywanej przez urządzenia IT. Im wartość bliższa wartości 1,0 tym mniej energii jest tracone na potrzeby utrzymania ruchu serwerowni i zapewnienia dostępu do usług informatycznych. Stąd rodzą się czasami zupełnie fantastyczne pomysły lokalizowania serwerowni np. pod kołem podbiegunowym, w fiordach lub na statkach zakotwiczonych na morzu. Po prostu wykorzystanie naturalnego chłodu (frecoolingu) w procesie chłodzenia serwerowni pozwala w większym stopniu zbliżyć się do pożądanego PUE=1.

Jak zbudowana jest tradycyjna serwerownia? Jest ona budynkiem lub jego częścią, na którą składa się komora serwerów, w której instalowany jest sprzęt IT oraz pomieszczenia i obszary wspierające jej funkcjonalność, w tym pomieszczenia np.: UPS, dystrybucji energii, techniczne, telekomunikacyjne, operacyjne, pomieszczenia dystrybucji chłodu oraz obszary posadowienia agregatów prądotwórczych, agregaty chłodu, zbiorniki paliwa, itp. Wszystkie te urządzenia / systemy techniczne zwane infrastrukturą dzieli się na infrastrukturę informatyczną oraz infrastrukturę techniczną.

Na Infrastrukturę Informatyczną składają się wszystkie urządzenia systemów komputerowych, w tym urządzenia aktywne i pasywne sieciowe, serwery i pamięci masowe, wraz z okablowaniem logicznym miedzianym i światłowodowym, przyłączami telekomunikacyjnymi, której działanie jest niezbędne do osiągnięcia celu biznesowego jakiemu towarzyszy działanie serwerowni

Infrastruktura Techniczna – to maszyny, urządzenia, systemy i instalacje techniczne, w szczególności systemy i instalacje elektroenergetyczne i teletechniczne oraz systemy i instalacje mechaniczne związane głównie z utrzymaniem właściwych parametrów środowiska (wilgotność i temperatura), właściwych dla bezpiecznego użytkowania systemów IT, np. zgodnie z zaleceniami producentów lub niezależnych instytucji standaryzacyjnych np. ASHRAE (Amerykańskie Stowarzyszenie Inżynierów Ogrzewnictwa Chłodzenia i Klimatyzacji). . Schneider Electric jest producentem wysoko efektywnych, sprawnych i niezawodnych urządzeń do realizacji dowolnej konfiguracji systemów zasilania i chłodzenia w serwerowniach.

Infrastruktura techniczna może być oparta o różne technologie, bardziej lub mniej przyjazne środowisku a także zarządzania w sposób sprzyjający minimalizujące zużycia energii, szczególnie jeśli serwerownia nie osiąga nominalnego (tzn. obliczeniowego) obciążenia (tzn. wykorzystania), czyli powierzchnia serwerowni jest niedociążona. W takim przypadku wskaźnik PUE może osiągać bardzo niezadowalające wyniki a koszty eksploatacji jednostkowo rosną. W przypadku eksploatacji serwerowni może istnieć wiele strategii regulacji powodujących minimalizowanie zużycie energii opartych o centralne systemy zarządzania i oprogramowanie klasy DCIM (Data Center Infrastructure Management).W zależności od obciążenia serwerowni oraz występujących warunków atmosferycznych strategie będą realizować algorytmy maksymalizacji wykorzystania freecolingu. Przykładem takiego oprogramowania jest InfraStruxture firmy Schneider Electric.

Ciągły dostęp do usług serwerowni i bezpieczeństwo danych

W związku z powszechnym zastosowaniem informatyki i przetwarzania danych we wszystkich aspektach życia społecznego, aktywności gospodarczej oraz administracji publicznej, zapewnienie ciągłego dostępu do usług biznesowych serwerowni a także bezpieczeństwo danych stało się krytyczne. Dostosowanie infrastruktury do wymagań wysokiej niezawodności i dostępności danych stało się nową dziedziną techniki podlegającą procesowi kwalifikacji i certyfikacji. Zostały zawiązane komercyjne ciała doradcze, np. Uptme Institute, Building Industry Consulting Service International (BICSI) oraz normalizacyjne, Telecommunications Industry Association (TIA), European Committee for Electrotechnical Standardization (CENELEC), lub inne nie wymienione tutaj. Obecnie budowane serwerownie opierają się o lokalne wymagania odnośnych urzędów związanych z obowiązującym w każdym kraju lokalnym Prawem Budowlanym oraz jednocześnie spełniają określone wymagania niezawodności (np. TIER wg. Uptime Institute lub RATED według TIA) i ochrony danych w zakresie ochrony własności intelektualnej, poufność i bezpieczeństwa danych (w Polsce PN-ISO/IEC-17799), oraz bezpieczeństwa fizycznego dostępu (w Polsce PN-ISO-I-13335-1).

Dzisiejsze serwerownie w zakresie zapewnienia niezawodnej pracy urządzeń IT cechuje przede wszystkim bezpieczeństwo (określenie jako dostępność lub niezawodność) oparte o rozwiązania techniczne (głównie wielowymiarową redundancje urządzeń i systemów infrastruktury oraz bezpieczeństwo i ciągłość zasilania i chłodzenia) oraz restrykcyjne procedury związane z kompetencjami personelu, procedurami eksploatacyjnymi oraz remontowymi a także procedury wprowadzania zmian. Lokalizacja serwerowni jest starannie rozpatrywana, nie tylko pod względem dostępności do mediów, dostępności do pasma, odległości wpływającej na notowane w aplikacjach opóźnienia, ale także ze względu na fizyczne bezpieczeństwo danych. W kwestii niezawodności funkcjonalnej szczegóły można znaleźć na portalu http://serwerownie.org

Trendy w budowie serwerowni

W serwerowni najważniejsze są realizowane usługi oraz stały do nich dostęp. Stawia to na plan dalszy koszty operacyjne (OPEX), w tym koszty energii, pod warunkiem, że na oferowaną usługę w określonej cenie znajdzie się Klient. Dlatego też budowa serwerowni wiąże się ze starannym przygotowaniem, analizą oraz biznes planem. Nie można także postawić twierdzenia, że każda wybudowana lub planowana serwerownia będzie pełniła uniwersalną funkcję dla każdego rodzaju aplikacji i typu usług.

Różne usługi oraz aplikacje wpływają w bezpośredni sposób na wymagania, przede wszystkim w zakresie parametrów samej infrastruktury informatycznej. Portale internetowe lub społecznościowe serwujące dostęp do wiadomości lub sieć korporacyjna z dostępem do baz danych i serwisów pocztowych czy gry on-line lub usługi mobilne albo analityka obrazu realizowana w czasie rzeczywistym stawiają zupełnie inne wymagania techniczne w zakresie większej przepustowości i mniejszych opóźnień w komunikacji, które wiążą się głównie odległością od źródła danych do użytkownika.

Mniej wymagające usługi związane z przechowywaniem, serwowaniem i gromadzeniem danych, usługami pocztowymi, witrynami komercyjnymi maja mniejsze w tym zakresie wymagania. Usługi związane z Video-analityką, robotyzacja, procesy generujące duże ilości danych udostępnianie zdalnie do analizy w czasie rzeczywistym (analityka laboratoryjna, analiza obrazowa, produkcja) lub zarządzania danymi on-line np. z dronów, kamer polowych (mobilne centra kryzysowe) lub „Big Data” wymagające potężnego przetwarzania (analityka statystyczna, analiza korelacji) wiążą się z mniejszymi opóźnieniami i większymi wymaganiami w zakresie przepustowości pasma. Wszystkie te wymagania wpływają na większe rozproszenie infrastruktury dzieląc ją na mniejsze lub mikro serwerownie zbliżające się do użytkownika. Większe rozproszenie w przypadku usługodawców oferujących usługi w „chmurze” sprzyja także bezpieczeństwu danych oraz Disaster Recovery (odzyskaniu danych i przywróceniu dostępu do usług) w przypadku wystąpienia awarii. Podsumowując. Wielkość i lokalizacja serwerowni jest uzależniona od rodzaju usług i aplikacji, które są realizowane przez jej infrastrukturę informatyczną, z kolei potrzeba obniżania zużycia energii oraz planowana niezawodność funkcjonalna wpływają na zastosowane rozwiązania w infrastrukturze technicznej, w tym większe wykorzystanie obniżenia zużycia energii przez wykorzystanie freecoolingu) oraz w końcu na samą organizację służb odpowiedzialnych za eksploatację serwerowni.

Podsumowując. Wielkość i lokalizacja serwerowni jest uzależniona od rodzaju usług i aplikacji, które są realizowane przez jej infrastrukturę informatyczną, z kolei potrzeba obniżania zużycia energii oraz planowana niezawodność funkcjonalna wpływają na zastosowane rozwiązania w infrastrukturze technicznej, w tym większe wykorzystanie obniżenia zużycia energii przez wykorzystanie freecoolingu) oraz w końcu na samą organizację służb odpowiedzialnych za eksploatację serwerowni.

Krzysztof Szczygieł

Autor jest Prezesem Polskiego Instytutu Data Center S.A. i ekspertem w CENELEC TC215 WG03 w zespole opracowującym zespół norm EN 50600 „Data centre infrastructure and facilities”

Autor jest Prezesem Polskiego Instytutu Data Center S.A. i ekspertem w CENELEC TC215 WG03 w zespole opracowującym zespół norm EN 50600 „Data centre infrastructure and facilities”

Terminologia – data center czy to coś znaczy?

Terminologia w obszarze zagadnień objętych wspólnym pojęciem „data center” nastręcza jak zwykle wiele trudności. Już sam termin angielski jest używany dwojako – jako „data center” lub „data centre”. W angielskiej wersji wersję „data centre” należałoby uznać za bardziej odpowiednią ponieważ tak jest używana w normach europejskich z serii EN 50600 (i brytyjskich BS-EN 50600).

W powszechnym użytku, w języku polskim są trzy określenia – data center, serwerownia i centrum przetwarzania danych.

Poprawnym określeniem, z punktu widzenia formalnego jest „centrum przetwarzania danych” ponieważ takie właśnie tłumaczenie terminu „data centre” zostało przyjęte w normie PN-EN 50600-1.

Formalna strona, formalną stroną, ale w polskiej wersji, jak zresztą w wielu innych przypadkach najsilniejszą formę potoczną ma anglicyzm „data center” w tej właśnie formie. Nie dyskutujemy tu oczywiście o tym czy tak jest lepiej czy nie, ale jedynie o tym jak rozumiemy terminy z tego zakresu.

Wymiennie z „data center” bardzo często spotyka się określenie „serwerownia” jako przekształconą formę z „server room”. Czasami, choć rzadko spotyka się określenie „sala komputerowa” (od „computer room”). Wbrew pozorom byłoby to bardziej odpowiedni zamiennik pojęcia centrum przetwarzania danych niż serwerownia ponieważ „computer room space” (EN 50600-1 p.3.1.7) to określona w normie „strefa przetwarzania danych” (PN-EN 50600-1 p.3.1.7). Co prawda, strefa przetwarzania danych jest tylko częścią (wprawdzie najważniejszą) centrum przetwarzania danych, ale „server room” w normalizacji nie jest używany.

Istnieje jeszcze termin „ośrodek obliczeniowy”, który historycznie byłby najbardziej odpowiedni albowiem było to pierwsze polskie określenie obiektów tego typu. Jednakże, w aktualnym ujęciu termin ten używany jest w kontekście archaicznym. Jest dość rzadko używany i stawia przed oczami w miejsce nowoczesnej infrastruktury raczej olbrzymich rozmiarów maszyny matematyczne starego typu niż nowoczesne serwery. Trzeba jednak zauważyć, że odpowiadające, niemieckie określenie „Rechnenzentre” (DIN-EN 50600-1) przetrwało próbę czasu i jest obecnie używane. Z kolei francuskie „de centres de traitement de données” to nasze centrum przetwarzania danych nieomal dosłownie.

Osobną kwestią jest sama definicja centrum przetwarzania danych. W zależności od normy określenie to nieco się różni i tak:

• Wg PN-EN 50600-1 (p.3.1.9)

Centrum przetwarzania danych (ang. data centre) to:

budowla lub zespół budowli przeznaczone do zgrupowania pomieszczeń, połączeń i obsługi urządzeń techniki informacyjnej oraz sprzętu sieci telekomunikacyjnych zapewniających usługi przechowywania, przetwarzania i dostarczania danych wraz z pełnym wyposażeniem i infrastrukturą do dystrybucji energii i zapewnienia parametrów środowiskowych oraz koniecznego poziomu odporności i zabezpieczeń wymaganych w celu zapewnienia pożądanej dostępności usług

• Wg ANSI/TIA 942–A (p.3.2)

Centrum przetwarzania danych (amer. data center):

budynek lub jego wydzielona część, której podstawowe funkcje zostały tak zaplanowane, aby stanowiły obszar przygotowany do zlokalizowania pomieszczenia serwerów oraz jego zaplecza technicznego.

Teoria, teorią jednak potocznie nadal używa się pojęcia „data center” lub słowa „serwerownia”. Można jeszcze się zastanowić czy są to pojęcia całkowicie wymienne. Jest jasne, że dla słów używanych potocznie nie ma ścisłych definicji i rozumienie tych pojęć jest całkowicie wymienne niemniej w głębszych półcieniach zabarwienia tych słów uznaje się, że serwerownia to obiekt trochę mniejszy o skromniejszym wyposażeniu niż data center. Centrum przetwarzania danych to określenie używane w stylistyce formalnej, rzadziej w języku mówionym. Natomiast oznacza ono już jak zostanie użyte, z reguły obiekt o sporej wielkości z dedykowanym wyposażeniem i funkcjami.

Awaria - wystąpienie nieprzewidzianego nagłego zakłócenia (uszkodzenia) w prawidłowo eksploatowanym i konserwowanym urządzeniu, systemie lub instalacji serwerowni, które powoduje utratę funkcjonalności lub zmniejszenie ich zdolności użytkowej;

ANSI/BICSI 002-2011 Data Center Design and Implementation Best Practices – dokument określający znane i stosowane wymagania, porady oraz wszelkie informacje, które powinny być brane pod uwagę przy pracy z systemami o krytycznym znaczeniu dla funkcjonowania serwerowni, w tym instalacji takimi jak: instalacje elektryczne, mechaniczne (klimatyzacja precyzyjna i inne sanitarne, chłodnicze itp.), sieci telekomunikacyjne, a także inne istotne aspekty jej budowy, takie jak wybór lokalizacji i prowadzenia procesu budowlanego, zapewnienie bezpieczeństwa fizycznego, itp.;

Bezpieczeństwo funkcjonalności – skuteczne zapewnienie przez infrastrukturę techniczną funkcjonalności serwerowni zgodnie z SLA

Serwerownia – wybudowany i wyposażony w Infrastrukturę techniczną obiekt pełniący rolę Centrum Przetwarzania Danych wraz z przyległą do niego infrastrukturą naziemna i podziemną znajdującą się na jego ogrodzonym terenie (łącznie z z ogrodzeniem);

Czas naprawy - okres od wystąpienia Awarii do przywrócenia funkcjonalności albo wdrożenie rozwiązania zastępczego o zbliżonych parametrach, gwarantującego odpowiedni poziom funkcjonalności i zapewniającego utrzymanie dostępu do usługi biznesowej serwerowni;

Czas naprawy awarii krytycznej – wykonanie naprawy w określonym w SLA czasie bez względu na wartość mierników funkcjonalności napraw urządzeń, instalacji, systemów;

Czas naprawy awaryjnej – wykonanie naprawy w ustalonym terminie w przypadku zapewnienia funkcjonalności w przedziale dopuszczalnym przez mierniki funkcjonalności (II /III kat. Serwisowej);

Czas naprawy ostatecznej - okres od wystąpienia awarii do przywrócenia urządzenia, instalacji, systemu do pełnej sprawności na poziomie funkcjonalności;

Części zamienne – wykaz części zamiennych i ich dostępności koniecznych do wywiązania się z napraw awaryjnych i ostatecznych zgodnie z SLA;

Dokumentacja serwerowni – Projekt wykonawczy i powykonawczy, dokumentacja techniczna oraz eksploatacyjna, procedury, raporty i analizy stworzone po wybudowaniu i wyposażeniu serwerowni, uwzględniające wszystkie zmiany zaistniałe w trakcie procedur rozruchowych i bieżącej eksploatacji;

Dostawca Usługi Utrzymaniowej – Służby techniczne własne lub zewnętrzne, działające na zasadach określonych w umowie, realizujące usługę utrzymywania Infrastruktury Technicznej na poziomie zarządzania w pełnej sprawności poprzez podejmowanie profesjonalnych, z góry ustalonych przez właściwe procedury działań, z uwzględnieniem wszelkich skutków technicznych, organizacyjnych, prawnych itp., jakie te działania mogą spowodować w realizacji podstawowych działań biznesowych serwerowni;

Dostępność – Jest to właściwość infrastruktury technicznej. Opisuje jej gotowość do wykonywania swojej funkcji. To także jeden ze wskaźników efektywności technicznej odnoszący się do niezawodności oraz SLA. W polskich normach wskaźnik ten nazywany jest również gotowością. Zazwyczaj rozpatruje się dostępność operacyjną lub techniczną. Różnice wynikają z tego, czy oblicza się zdatność infrastruktury technicznej w czasie kalendarzowym, operacyjnym czy innym. Na świecie przyjmuje się 9 głównych definicji dostępności, dlatego każdorazowe posługiwanie się tym wskaźnikiem powinno zostać poprzedzone klarownym przedstawieniem co przez niego rozumiemy. Definicja dostępności jest reprezentowana wskaźnikiem procentowym opisującym stosunek ilości czasu, w którym infrastruktura techniczna była zdatna (funkcjonalnie lub technicznie), do całkowitego czasu kalendarzowego (lub czasu planowanej pracy) w określonym okresie. Wskaźnik ten może być obliczany w ujęciu tygodniowym, miesięcznym, rocznym itd. Stosuje się różne praktyki w zliczaniu czasu dostępności. Czasami definiuje się zakres, kiedy uznaje się, że infrastruktura techniczna jest dostępna, a kiedy nie. Dobrą praktyką jest zdefiniowanie na potrzeby swojej organizacji, co dokładnie będzie się rozumieć przez pojęcie dostępności infrastruktury technicznej. Wskaźnik umożliwia również realizowanie benchmarkingu. Chodzi tu o porównywanie dostępności urządzeń / systemów, np. w ramach jednej branży. Dla każdego przedsiębiorstwa, cele dotyczące dostępności są celami strategicznymi. To one wpływają na pozostałe elementy systemu utrzymania ruchu;

DTR – dokumentacja techniczno – ruchowa poszczególnych elementów Infrastruktury ;

Funkcjonalność - zespół optymalnych/ustalonych/użytkowych/technologicznych parametrów środowiska wewnętrznego serwerowni, które muszą być zapewnione przez pracę urządzeń, instalacji i systemów oraz przez pracę personelu odpowiedzialnego za organizację serwisu i za obsługę tego środowiska;

Funkcjonalność Infrastruktury Technicznej – zespół optymalnych parametrów technicznych środowiska wewnętrznego serwerowni, tj. parametry powietrza i mediów zasilających oraz poziom przygotowania technicznego i organizacyjnego służb dostawcy usługi utrzymaniowej;

Harmonogram Bazowy – harmonogram Konserwacji, Przeglądów okresowych i Specjalistycznych przeglądów okresowych elementów Infrastruktury , zgodny z DTR, opracowany do wdrożenia przez Dostawcę Usługi Utrzymaniowej;

Harmonogram Wykonawczy – zaakceptowany do realizacji Harmonogram Bazowy;

HPAC/PAC/CCAC – High Precision Air Conditioning/ Precision Air Conditioning/ Close Control Air Conditioning – Klimatyzacja Precyzyjna dedykowana dla obsługi obszaru serwerowni.

HVAC&R – Heating/Ventylation Airconditioning & Refrigeration – grzanie, wentylacja, klimatyzacja I chłodzenie - zapis nazw procesów sanitarnych/mechanicznych/chłodniczych wg standardów amerykańskich.

Infrastruktura lub Infrastruktura techniczna – maszyny, urządzenia, systemy i instalacje techniczne, w szczególności systemy, urządzenia i instalacje elektroenergetyczne oraz systemy klimatyzacji precyzyjnej i pozostałe instalacje sanitarne, z wyłączeniem: systemów IT, systemów bezpieczeństwa (system sygnalizacji pożaru, system gaszenia gazem, system kontroli dostępu, system sygnalizacji włamania i napadu oraz system telewizji dozorowej), sieci telekomunikacyjnej WAN i sieci telekomunikacyjnej LAN (w obrębie komór serwerowych);

Infrastruktury informatyczna – urządzenia systemów komputerowych, w tym urządzenia aktywne i pasywne sieciowe, serwery i pamięci masowe, wraz z okablowaniem logicznym miedzianym i światłowodowym, przyłączami telekomunikacyjnymi, której działanie jest niezbędne do osiągnięcia celu biznesowego jakiemu towarzyszy działanie serwerowni;

Infrastruktura techniczna o znaczeniu krytycznym – ta część Infrastruktury technicznej, której działanie jest niezbędne do utrzymania ciągłości działania serwerowni;

Infrastruktura elektroenergetyczna – system, zespół urządzeń, instalacji, jej elementów połączonych technologicznie w określonej konfiguracji przez projekt, dobre praktyki techniczne, DTR urządzeń i wymagania użytkowe na poziomie niezawodności określonej przez SLA, w jedną funkcjonalną całość i przeznaczony do rozdzielania, przesyłania i awaryjnego wytwarzania energii elektrycznej;

Infrastruktura sanitarna / mechaniczna – HVAC&R – infrastruktura techniczna, w skład której wchodzą systemy klimatyzacji precyzyjnej (HPAC), systemy chłodnicze, systemy automatyki dedykowane tym systemom i pozostałe systemy sanitarne, tj. ciepła technologicznego, wodno-kanalizacyjne. Zespół urządzeń i instalacji połączonych technologicznie w określonej konfiguracji przez projekt, dobre praktyki techniczne, DTR urządzeń, wymagania użytkowe oraz wymagania, regulacje i przepisy prawne na poziomie niezawodności określonej przez SLA w jedną funkcjonalną całość i przeznaczony do zapewnienia wymaganych parametrów klimatyzacyjnych środowiska wewnętrznego o zdefiniowanych wartościach, tj. temperatura, wilgotność, nadciśnienie, ilość wymian, objętości, prędkości przepływu powietrza i jego czystość, poziomu głośności;

Instalacja – całość połączonych ze sobą technologicznie w odpowiedniej konfiguracji elementów, zdefiniowanej przez projekt, DTR producenta urządzeń i elementów lub wymagania techniczne i inne, przeznaczonych do zapewnienia prawidłowej pracy urządzeń;

Kategorie serwisowe - priorytet naprawy elementu infrastruktury technicznej, priorytety dla napraw mogą ulec zmianie w zależności od oceny sytuacji po awarii;

Klasyfikacja TIER – zalecenia stawiane przez Uptime Institute (TIER I…IV), w stosunku do projektowania i zastosowania rozwiązań technicznych infrastruktury technicznej. Certyfikacja TIER w Uptime Institute jest zbieżna z normą TIA/ANSI 942 dając dodatkowe zalecenia i wytyczne do oceny jakości i sposobu zarządzania oraz serwisowania infrastruktury technicznej serwerowni zapisane w dokumencie pt. „Uptime Institute – Data Center Operational Sustainability”;

Kluczowe Wskaźniki Efektywności (Key Performance Indicators - KPI) - Menedżerowie i inżynierowie, wyznaczając istotne grupy danych, kierują swoją uwagę na kluczowe efekty działalności systemu utrzymania ruchu: rezultaty operacyjne, niezawodność, jakość, wydajność, opłacalność realizowanych działań eksploatacyjnych. Przedstawienia tych danych dokonuje się z użyciem kluczowych wskaźników efektywności (Key Performance Indicators), które są w obecnych czasach jednym z podstawowych narzędzi stosowanych w systemach mierzenia efektywności utrzymania ruchu (Maintenance Performance Measurement Systems). Celem stosowania kluczowych wskaźników efektywności utrzymania ruchu jest przede wszystkim pozyskanie bieżących i historycznych wartości miar własności eksploatacyjnych oraz relacji m.in. w celu skonfrontowania otrzymanych wartości z wartościami projektowymi oraz z wartościami uzyskanymi w wyniku obserwacji innych systemów eksploatacji lub innych obiektów technicznych, dzięki czemu można przeprowadzić benchmarking. Wskaźniki efektywności pomagają również w diagnostyce realizowanych działań zarządzania, użytkowania i utrzymania, monitorowania zmian i postępu w systemie eksploatacji i motywowania oraz rozliczania personelu technicznego i zarządzającego z uzyskanych wyników.

Konserwacja - cykliczne realizowanie kompleksowych czynności diagnostycznych oraz działań technicznych, wykonywane zgodne z Harmonogramem Wykonawczym, zaleceniami producentów zapisanymi w DTR, zaleceniami Projektanta, zapisami instrukcji obsługi Użytkownika, mających na celu zachowanie wymaganego stanu technicznego, sprawności i niezawodności eksploatacyjnej Infrastruktury oraz obniżenie intensywności jej ponadnormatywnego zużycia; do zakresu czynności konserwacyjnych należą między innymi: dostawa, montaż, wymiana, uzupełnianie materiałów eksploatacyjnych (np. olejów, smarów, płynów, chłodniczych czynników roboczych, tj. mieszaniny niskokrzepliwe, tzw. freony, filtrów, cylindrów nawilżaczy) i części zamiennych do Infrastruktury , zgodnie z DTR lub innymi dodatkowymi wymaganiami;

Kontrola - codzienny lub okresowy nadzór pracy i ocena stanu technicznego Infrastruktury , bez znaczącego udziału materiałów i robocizny, wraz z ewentualnymi regulacjami mechanicznymi i korektą nastaw parametrów pracy, uruchomieniami i pomiarami realizowanymi na obiekcie;

Mapowanie Procesów (Process Mapping) - jest to przedstawianie w formie graficznej procesów zachodzących w organizacji i na jej skraju we współpracy z zewnętrznymi uczestnikami działań. Mapowanie to pierwszy krok do wdrożenia podejścia procesowego w przedsiębiorstwie. Głównym celem opracowywania map jest lepsze poznanie zasady działania własnej organizacji. Ułatwia to identyfikację miejsc, w których występuje marnotrawstwo, opóźnienia lub rozmycie odpowiedzialności. Najczęstszym motywem do wprowadzenia podejścia procesowego jest chęć uregulowania odpowiedzialności za poszczególne działania dzięki czemu można działać sprawniej oraz uniknąć tzw. „spychologii”. W przypadku firm posiadających kilka jednostek biznesowych mapy procesów umożliwiają szybkie ujednolicenie procedur w różnych lokalizacjach. Mapy procesów AS-IS przedstawiają obecny przebieg procesu, natomiast TO-BE to stan, do którego dążymy.

Mierniki funkcjonalności - zespół parametrów środowiska wewnętrznego serwerowni, określonych wartościami granicznymi niekrytycznymi (minimalne i maksymalne) oraz wartościami krytycznymi (minimalne i maksymalne);

Naprawa awaryjna – naprawa maszyn, urządzeń, systemów lub instalacji wymuszona wystąpieniem Awarii, mająca na celu przywrócenie ich zdolności użytkowej / funkcjonalnej lub zastosowanie rozwiązania zastępczego zapewniającego funkcjonowanie w przedziałach określonych przez Mierniki funkcjonalności;

Naprawa ostateczna – przywrócenie maszyn, urządzeń, systemów lub instalacji do stanu sprzed wystąpienia Awarii (stan podstawowy i redundancja);

Obsługa bieżąca - zestaw czynności obejmujący: utrzymywanie bezpośrednio na obiekcie stałego dyżuru serwisowego, utrzymywanie stałej gotowości do wykonania interwencji serwisowej (usuwania usterek w działaniu Infrastruktury oraz dokonywania Napraw awaryjnych), monitorowanie stanu Infrastruktury technicznej, w tym obsługę systemów zdalnego monitorowania, bieżące usuwanie usterek Infrastruktury i dokonywanie Napraw awaryjnych, Kontrolę, koordynację realizowanych przez Dostawcę lub Specjalistyczne służby serwisowe Konserwacji, Przeglądów okresowych, Specjalistycznych przeglądów okresowych oraz Specjalistycznych napraw awaryjnych, aktualizację Dokumentacji, opracowywanie i uzupełnianie harmonogramów prac w określonych przedziałach czasowych, instrukcji i procedur postępowania w sytuacjach awaryjnych, przygotowanie i aktualizację planu awaryjnego, opracowywanie raportów o stanie Infrastruktury , opracowywanie raportów o stanie magazynów i zużyciu materiałów, utylizację odpadów powstałych przy realizacji Usługi Utrzymaniowej. Prowadzenie na bieżąco dziennika zdarzeń (szczegółowej informacji o awariach i nieprawidłowościach i wszystkich przypadkach związanych z wystąpieniem utraty funkcjonalności Infrastruktury ), zarządzanie i koordynację prac własnych, prac Podwykonawców;

Przeglądy okresowe – cykliczne specjalistyczne czynności serwisowe o szerszym niż Konserwacja zakresie, prowadzone profilaktycznie przez Dostawcę lub Specjalistyczne służby serwisowe, zgodnie z opracowanym harmonogramem prac, według zasad określonych przez: producenta maszyn/urządzeń (DTR) jak i projektanta w projektach instalacji, specjalistów z obszaru funkcjonalności infrastruktury technicznej w zakresie jej obsługi i użytkowania, precyzujących zarówno zakres czynności konserwacyjnych jak i częstotliwość ich wykonywania w celu utrzymania wymaganej zdolności użytkowej i eksploatacyjnej i zachowania gwarancji w okresie gwarancyjnym; w zakres Przeglądów okresowych wchodzi wymiana materiałów eksploatacyjnych z częstotliwością określoną przez instrukcje obsługi, DTR lub inne dokumenty lub wytyczne;

Serwis – usługa serwisowa – profesjonalne świadczenie usługi utrzymaniowej środowiska wewnętrznego serwerowni przez dostawcę Usługi serwisowej zgodnie z definicją Utrzymania ruchu zapewniającej jego funkcjonalność z zachowaniem wymagań SLA;

Serwis utrzymania ruchu infrastruktury technicznej na poziomie bezpieczeństwa funkcjonalnego to kompleksowe zarządzanie przez Dostawcę usługi Usługą utrzymaniową w zakresie jej planowania, organizowania, nadzorowania, wykonania, koordynowania, kontrolowania. W ramach Usługi serwisowej realizowane są następujące zadania:

- obsługa bieżąca,

- kontrola codzienna lub okresowa,

- konserwacja,

- przeglądy okresowe,

- naprawy awaryjne i ostateczne,

- analiza ryzyka powstawania awarii i działań zapobiegających, itp.

SLA (Service Level Agreement) – parametry określające wymagany poziom realizacji Usługi utrzymania ciągłości działania serwerowni w ramach świadczenia Usługi Utrzymaniowej, na poziomie bezpieczeństwa funkcjonalności;

Specjalista serwisu – członek personelu Dostawcy Usługi Utrzymaniowej bądź jego Podwykonawcy, posiadający wiedzę i doświadczenie potwierdzone przez certyfikaty lub inne równoważne dokumenty, wystawione przez producentów lub autoryzowanych dystrybutorów bądź przedstawicieli producentów, potwierdzające, że wskazana osoba jest zdolna świadczyć Usługi serwisowe w zakresie urządzeń Infrastruktury dla określonej branży;

Specjalistyczne naprawy awaryjne - Naprawy awaryjne elementów Infrastruktury, które wymagają interwencji specjalistycznych służb serwisowych;

Specjalistyczne przeglądy okresowe – czynności profilaktycznie zastrzeżone przez producenta i projektanta, przeprowadzane przez Specjalistyczne służby serwisowe, według zasad ustalonych przez producenta lub dystrybutora bądź projektanta w zakresie zaprojektowanych instalacji i systemów lub innych określonych elementów Infrastruktury , wskazujące zarówno na zakres tych czynności jak i częstotliwość ich wykonywania w celu zachowania gwarancji (w okresie gwarancyjnym) na poziomie funkcjonalnym oraz utrzymania wymaganej zdolności użytkowej i eksploatacyjnej;

Specjalistyczne służby serwisowe - osoby bądź podmioty, w skład których wchodzą osoby odpowiednio przeszkolone, co jest potwierdzone certyfikatem bądź innym dokumentem, wydanym przez producentów danych urządzeń bądź ich autoryzowanych przedstawicieli lub dystrybutorów w Polsce, w zakresie świadczenia profesjonalnych usług serwisowych gwarancyjnych i pogwarancyjnych urządzeń i systemów stanowiących elementy Infrastruktury ;

Specjalistyczna usługa serwisowa (specjalista serwisu) – Specjalistyczny przegląd okresowy lub Specjalistyczna naprawa awaryjna elementu Infrastruktury świadczona przez wykonawcę lub podwykonawcę posiadającego wymagane świadectwa kwalifikacji i wymagane prawem certyfikaty wydane przez producentów danych urządzeń bądź ich autoryzowanych przedstawicieli lub dystrybutorów w Polsce;

System elektroenergetyczny – zespół urządzeń i instalacji połączonych technologicznie w określonej konfiguracji w jedną całość zgodnie z wymaganiami technicznymi określonymi w projekcie, wymaganiami DTR i przepisami, przeznaczonych do wytwarzania, przesyłania i rozdzielania energii elektrycznej;

System klimatyzacji precyzyjnej (CCAC, HPAC) – zespół urządzeń i instalacji połączonych technologicznie w określonej konfiguracji w jedną całość, przeznaczony do kształtowania i kontrolowania klimatyzacyjnych parametrów środowiska wewnętrznego (zapewniając funkcjonalność), tj. wymagane wartości temperatury, wilgotności, nadciśnienia i szybkości zmian tych parametrów w czasie, ilości wymian, objętości/prędkości przepływu powietrza i jego dystrybucji oraz poziomu głośności jego pracy;